Как часто вы слышите предсказания о конце света, в котором главную роль играет всемогущий искусственный интеллект? Минимум раз в неделю какой-нибудь бизнесмен или знаменитость выскажет опасения о страшном будущем под его гнетом.

Конечно, известная личность плюс мрачный прогноз — идеальный рецепт для громкого заголовка. Но если раньше сделанные по этой схеме материалы отражали реальный, порой пугающий прогресс в технологии, то теперь все чаще это напоминает пустой маркетинг или простое непонимание сути происходящего.

Почему же нас до сих пор пугают плохими пересказами «Терминатора», если современные чат-боты часто нагло врут и не могут запомнить пять строчек диалога? А самое главное — кому это может быть выгодно?

Не впечатляет

Сразу стоит отметить: ИИ-технологии сделали огромный скачок за последнее десятилетие. Современные системы научили писать связные тексты, распознавать закономерности в больших массивах данных и создавать визуальный контент. Еще недавно машины не могли заменить настолько человеческий труд.

Перспективы прогресса пугают. Однако на текущий момент развитие массовых продуктов остановилось лишь на разговорах о так называемом общем искусственном интеллекте и выпуске почти одинаковых языковых моделей (иногда новинки получаются даже хуже предшественников).

Что мы в итоге имеем: инструмент-помощник, который обучен выполнять простые задачи с текстом и иногда с картинками. Люди приспособили его для вайбкодинга или написания постов для соцсетей. При этом полученный результат зачастую требует перепроверки — на более комплексные работы нейросети неспособны.

Можете сейчас попросить своего любимого чат-бота написать докторскую диссертацию на тему «X»: получите с трудом связанный по смыслу текст со ссылками с первой или второй страницы поисковика. Для улучшения результата советуют использовать расширенные промпты, но это просто еще более тонкая настройка на «языке машины» и дообучение.

При продолжительном использовании ИИ, наверное, каждый пользователь осознает ограниченность сегодняшних моделей. Все прогрессирование в итоге уперлось в объемы баз данных для обучения и серверные мощности, а сам фактор «интеллекта» ушел на второй план.

Интеллект без мозгов

Для понимания контекста нужно объяснить механизм работы ИИ. Если коротко, большие языковые модели классических чат-ботов работают так:

- Входной текст разбивается на токены (части слов, символы).

- Каждому токену присваивается числовой вектор.

- Модель анализирует связи между токенами и определяет, какие слова наиболее важны для понимания контекста.

- На этой основе LLM «предсказывает» каждый следующий токен, формируя ответ.

«Предсказывает» модель не из пустоты. Для этого она прошла предварительное обучение на огромной базе данных, как правило, из открытых источников в интернете. Именно оттуда нейросеть черпает весь свой «интеллект».

Языковые модели не «понимают» текст в человеческом смысле, а вычисляют статистические закономерности. Все ведущие современные чат-боты используют одну и ту же базовую архитектуру с говорящим названием «Трансформер», которая работает по этому принципу.

Конечно, это грубое сравнение, но LLM можно назвать очень мощным калькулятором на основе большой базы данных. Сильный, нужный и упрощающий многие аспекты нашей жизни инструмент, но приписывать такой технологии полноценный интеллект пока рановато.

Современные чат-боты больше напоминают новую итерацию поисковиков (привет, Gemini в Google), нежели карманного всезнающего ассистента.

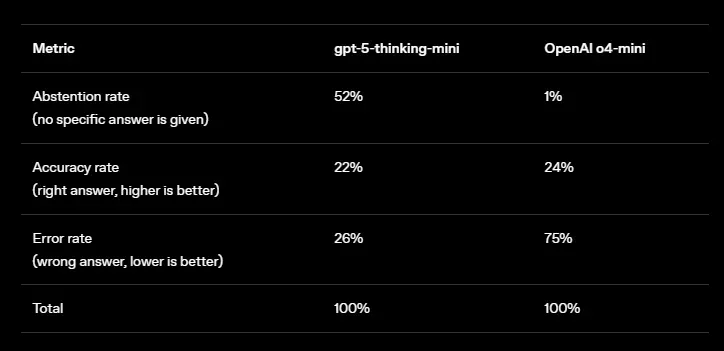

Тем более остаются вопросы к надежности ответов ИИ. После просмотра статистики галлюцинирования и вранья нейросетей появляется стойкое желание вернуться к классическому «погуглить».

Бу, испугался?

Главный тезис сторонников апокалипсиса заключается в том, что «ИИ становится умнее экспоненциально», поэтому как только он превзойдет человеческий интеллект людям как виду придет конец.

Современные ИИ, безусловно, уже опережают нас по точности обработки и преобразования данных. Например, нейросеть может достаточно подробно пересказать «Википедию». Но примерно на этом ее знания и ограничиваются. Точнее, модель просто не сможет применить их для «личных целей», поскольку не умеет, да и задачи у нее такой не стоит.

Кроме того, уже известно, что искусственный интеллект не понимает окружающий нас мир. Законы физики для ИИ — темный лес.

Все развитие языковых моделей свелось к расширению спектра прогнозирования (угадывания токенов). Однако ИИ быстро приближается к пределам возможностей текстового обучения, и все чаще звучат мысли о необходимости создания «пространственного» интеллекта.

Но если слабые места самой технологии еще можно определить, и работа в этих направлениях уже ведется, то более сложные вопросы остаются открытыми.

Даже для человечества многие аспекты устройства головного мозга остаются загадкой. Что говорить о воссоздании подобной сложной структуры в цифровой среде.

Помимо этого, другой почти непреодолимой преградой для ИИ становится креативность — способность создавать нечто новое. LLM технически не способны выходить за пределы своих архитектурных ограничений, поскольку их работа основана на переработке уже имеющихся данных.

Таким образом, дальнейшая судьба ИИ напрямую зависит от того, какую информацию человечество в него вкладывает, а пока что все материалы для обучения ориентированы исключительно на пользу людям.

Справедливости ради стоит упомянуть Илона Маска и его Grok. В один момент пользователи обратили внимание на предвзятость чат-бота и на тенденцию переоценивать способности миллиардера. Сигнал достаточно тревожный с точки зрения этики, но вряд ли потенциальный «нейроИлон» сможет навредить человечеству физически.

Так повелось, что единственная цель приложений искусственного интеллекта — подчиняться запросам пользователя. Чат-бот не имеет воли или собственных желаний, и в обозримом будущем парадигма вряд ли изменится.

Анатомия страха

И почему же нас до сих пор пугают этим самым ИИ, который оказался не очень «умным» изобретением? Основные ответы лежат на поверхности.

Если не брать в расчет непонимание технологии, самая простая причина — жадность до денег или до популярности.

Давайте обратимся к кейсу одного из «пророков судного дня» — Элиезера Юдковски. ИИ-исследователь и соавтор книги If Anyone Builds It, Everyone Dies («Если кто-то построит это, умрут все») с 2000-х предупреждает о сверхразумном ИИ, которому якобы будут чужды человеческие ценности.

«Сверхинтеллекта» пока не видно, в чем часто признается сам Юдковски. Но это не мешает ему выступать на подкастах с громкими заявлениями и продавать книги.

Известный физик и «крестный отец ИИ» Джеффри Хинтон тоже высказывал около апокалиптичные опасения. Он оценил вероятность того, что технология с вероятностью 10-20% приведет к вымиранию человечества в ближайшие 30 лет.

По мнению Хинтона, с ростом возможностей стратегия «держать искусственный интеллект под контролем» может перестать работать, а агентные системы будут стремиться к выживанию и расширению контроля.

В данном случае до конца не ясно, кто и для каких целей сможет дать нейросетям «волю к жизни». Хинтон продолжает работать в направлении обучения нейросетей и в 2024 году был номинирован на Нобелевскую премию за достижения в этом направлении, а в начале 2026 года он стал вторым ученым в истории после кибернетика Йошуа Бенжио, достигшим 1 млн цитирований.

На удивление, более приземленными выглядят прогнозы сооснователя Google Brain Эндрю Ына. Он называл искусственный интеллект «крайне ограниченной» технологией и выражал уверенность, что в обозримом будущем алгоритмы не смогут заменить людей.

Очевидно, острые на язык громкие прогнозисты есть в любой сфере. К тому же их существование в ИИ-индустрии вполне можно оправдать большой любовью народа к научной фантастике. Кому же не хочется пощекотать себе нервы историями в духе Филипа Дика или Роберта Шекли, с тем лишь отличием, что сюжет разворачивается уже в текущей действительности.

Больше вопросов в такой обстановке вызывают заявления крупных корпораций, которые будто невзначай предупреждают об угрозе рабочим местам и прогнозируют стремительное развитие ИИ. Если второй тезис во многом объясняет необходимость сокращения расходов, то первый невольно подталкивает к более конспирологическим интерпретациям.

Так, одна из крупнейших компаний в мире — Amazon — за последние полгода уволила более 30 000 сотрудников. Руководство ссылается на планы по оптимизации и влияние автоматизации, включая внедрение ИИ.

Развитие направления складских роботов никто не отменял. Однако злые языки считают проблему куда прозаичнее — в массовых чистках в компаниях виноват плохой HR-менеджмент времен пандемии COVID-19.

Amazon далеко не единственный пример. ИИ-компании из Силиконовой долины продолжают расширять штат сотрудников и арендовать новые помещения.

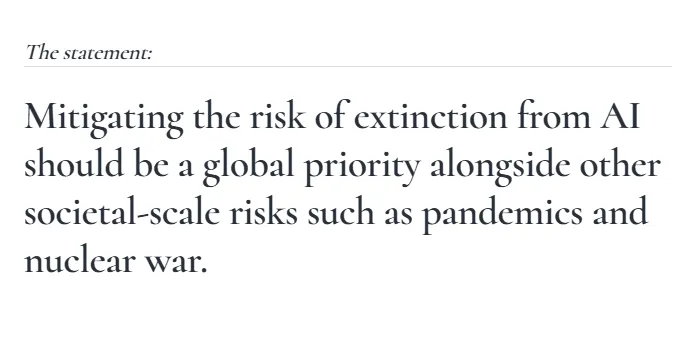

При этом еще в 2023 году почти все те же самые компании подписались под документом организации Center for AI Safety о замедлении развития технологии — якобы искусственный интеллект представляет «экзистенциальные риски» наравне с пандемиями и ядерными войнами.

Со временем письмо забылось, работа в направлении продолжилась, а видимой угрозы так и не появилось.

Рассуждая по-корпоративному, в эпоху разговоров о раздувшемся ИИ-пузыре апелляция к технологическим изменениям выглядит для бизнеса более удобным объяснением, чем признание структурных ошибок в управлении персоналом. Однако подобные заявления создают ложную картину происходящего и отвлекают от реальных проблем — дезинформации и дипфейков.

Искусственный интеллект не крадет рабочие места, он меняет сам подход к работе, в некоторых моментах упрощая ее. Хотя узкое исследование Гарварда демонстрирует, что ИИ, наоборот, иногда усложняет и замедляет процессы внутри компании.

Технология однозначно проникнет во все области нашей жизни: в образование, науку, торговлю, политику. Но в каком виде она там будет присутствовать, определят только сами люди. Пока у нейросетей не появилось право голоса.

Недоступное нам

Речь выше шла про общедоступные ИИ вроде чат-ботов и генеративных «рисовалок». Конечно, за закрытыми дверями существуют более серьезные разработки.

Среди относительно простых: LLM из области медицины или археологии. Первые, например, помогают синтезировать новые белки, а вторые — расшифровывать древние документы, неподдающиеся традиционному анализу.

Однако за итогами таких исследований, тестирований и запусков приходится следить через труднодоступные внутренние отчеты или по публикациям в узкоспециализированных медиа, поэтому степень осведомленности о них близка к нулю. Хотя вполне вероятно, что именно в этой области сейчас совершаются самые большие прорывы.

Вероятно, «ИИ-машине судного дня» не суждено появиться даже в закрытых лабораториях. Все подобные модели узкоспециализированы, поэтому умеют только то, что от них требуется.

Все опасения о выходе искусственного интеллекта из-под контроля — лишь отражения наших собственных страхов: будь то потеря работы или более сложные вопросы этики. Но пока мы, люди, определяем будущее технологии, задавая направление развития и цели, ИИ остается инструментом, а не отдельным субъектом с собственной волей.

Говорить о потенциальных рисках — правильно. Выдумывать апокалиптические теории — в порядке человеческой природы. Однако к таким вещам всегда нужно подходить с долей скептицизма или даже иронии. Если у нас под рукой есть кнопка «выкл», нашему миру не угрожает никакой цифровой сверхразум.

Василий Смирнов